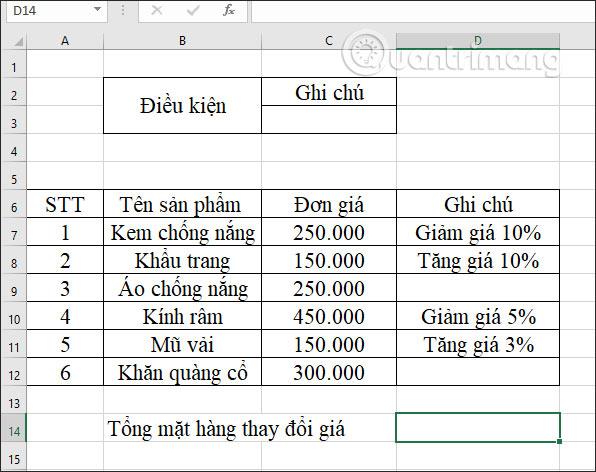

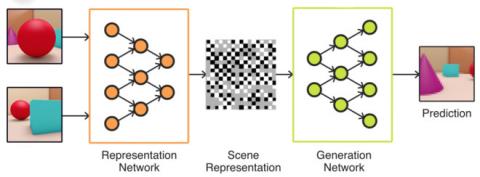

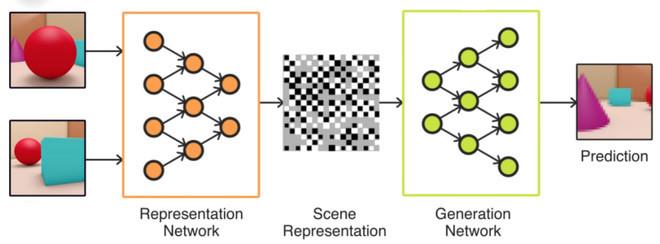

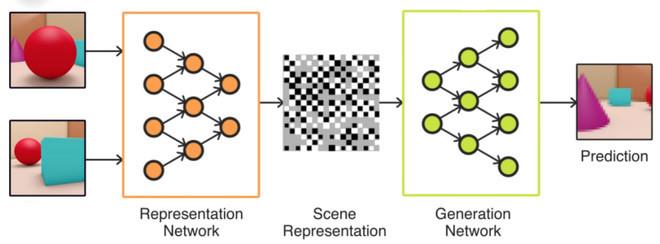

A DeepMind, az Egyesült Királyságban székelő Google-cég nemrégiben kifejlesztette a Generatív lekérdezési hálózatot (GQN) – egy neurális hálózatot, amelyet arra terveztek, hogy megtanítsa a mesterséges intelligenciát (AI) hogyan képzelje el, hogyan néznek ki az objektumok. Mit szólnátok a másik oldalról?

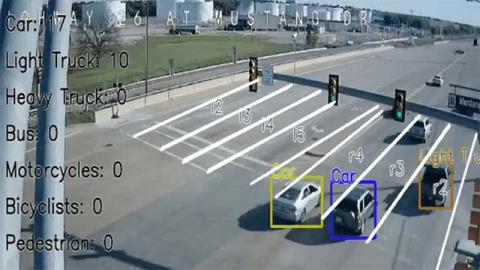

Konkrétan, az AI elemzi a 2D képeket, majd képes lesz 3D panoráma készítésére. Amit érdemes megemlíteni, hogy a DeepMind mesterséges intelligenciája csak legalább 3 képet néz meg minden bemeneti adat vagy tudás felhasználása nélkül, és azonnal meg tudja jósolni a kép 3D-s verzióját.

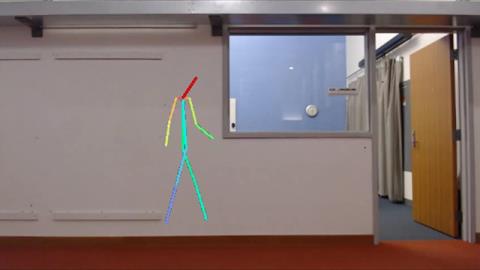

Az AI-kutatók megpróbálják megtanítani a gépeket, hogyan érzékeljenek emberként, környezetük megfigyelése után feltételezéseket fogalmaznak meg, konkrétan a bútorok és a jelenetek alakját különböző szögekből sejtik, hogy azt még nem „csodálták meg”.

Például lefényképez egy Rubik-kockát, és megkéri Ait, hogy készítse újra a képet egy másik szögből. Mesterséges intelligencia – a GQN használatával vizualizálni kell, hogy milyen lesz a kocka (világítás, árnyékolás, egyenes vonalak) a többi oldalon, hogy a kívánt képet renderelhessük.

Jelenleg a DeepMind mesterséges intelligencia rendszerét nem képezték a való világ képeivel. Ezután a kutatók hagyják, hogy valósághű tájakat jelenítsen meg fotókból.

A Deepmind GQN-t használó rendszere várhatóan csak 2D-s képeket tud majd használni rendkívül pontos 3D-s jelenetek létrehozásához a jövőben.

Többet látni: