Microsoft Research nedávno spôsobil rozruch vo svete výskumu umelej inteligencie (AI), keď oznámil úspešný vývoj DeepSpeed, knižnice na optimalizáciu hlbokého učenia, ktorú možno použiť na trénovanie obrovských modelov AI s rozsahom až 100 miliárd parametrov.

V tréningu AI platí, že čím väčšie modely prirodzeného jazyka máte, tým vyššia bude presnosť. Tréning veľkých modelov prirodzeného jazyka však zaberie veľa času a náklady s tým spojené nie sú malé. DeepSpeed sa zrodila, aby prekonala všetky vyššie uvedené ťažkosti: zlepšila rýchlosť, náklady, rozsah tréningu a použiteľnosť.

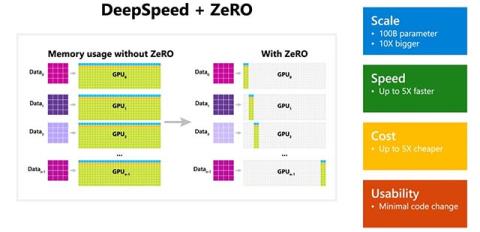

Okrem toho Microsoft tiež spomenul, že DeepSpeed zahŕňa aj ZeRO (Zero Redundancy Optimizer), techniku paralelnej optimalizácie, ktorá pomáha minimalizovať množstvo zdrojov potrebných pre modely a zároveň pomáha zvyšovať počet parametrov. Čísla je možné trénovať. Pomocou kombinácie DeepSpeed a ZeRO boli výskumníci spoločnosti Microsoft schopní úspešne vyvinúť nový model Turing Natural Language Generation (Turing-NLG) – najväčší jazykový model súčasnosti so 17 miliardami parametrov.

Niektoré výhody DeepSpeed:

- Mierka: Súčasné veľké, pokročilé modely AI ako OpenAI GPT-2, NVIDIA Megatron-LM a Google T5 majú rozsah 1,5 miliardy, 8,3 miliardy a 11 miliárd parametrov. ZeRO stupeň 1 v DeepSpeed môže poskytnúť systémovú podporu pre spustenie modelov s až 100 miliardami parametrov, čo je 10-krát viac ako najväčší model Google.

- Rýchlosť: Zaznamenané zvýšenie priepustnosti sa bude líšiť v závislosti od konfigurácie hardvéru. Na klastroch GPU NVIDIA s pripojením s nízkou šírkou pásma (bez NVIDIA NVLink alebo Infiniband) dosahuje DeepSpeed 3,75-násobné zlepšenie priepustnosti v porovnaní s použitím samotného Megatron-LM pre štandardný model GPT-2 s 1,5 miliardami parametrov. Na klastroch NVIDIA DGX-2 s vysokorýchlostným pripojením je pre modely s 20 až 80 miliardami parametrov DeepSpeed 3 až 5-krát rýchlejší.

- Náklady: Vďaka zlepšeniu rýchlosti sa výrazne optimalizujú aj náklady na školenia. Napríklad na trénovanie modelu s 20 miliardami parametrov vyžaduje DeepSpeed 3-krát menej zdrojov ako zvyčajne.

- Použiteľnosť: Na to, aby mohli súčasné modely prejsť na používanie DeepSpeed a ZeRO, je potrebných len niekoľko menších zmien kódu. DeepSpeed nevyžaduje redizajn kódu ani refaktoring modelu.

Spoločnosť Microsoft využíva otvorené zdroje DeepSpeed aj ZeRO na GitHub , pozrite si prosím.