A ChatGPT lenyűgöző képességei ellenére több nagy cég megtiltotta alkalmazottainak ezt az AI chatbotot.

2023 májusában a Samsung betiltotta a ChatGPT és más generatív AI- eszközök használatát . Aztán 2023 júniusában az ausztrál Commonwealth Bank, valamint olyan társaságok, mint az Amazon, az Apple és a JPMorgan Chase & Co is bevezette a korlátozást. Egyes kórházak, ügyvédi irodák és kormányzati szervek szintén megtiltották az alkalmazottaknak a ChatGPT használatát.

Miért tiltja tehát egyre több cég a ChatGPT-t? Íme 5 fő ok.

1. Adatszivárgás

A ChatGPT nagy mennyiségű adatot igényel a betanításhoz és a hatékony működéshez. A chatbotot hatalmas mennyiségű, az internetről nyert adat felhasználásával képezték ki, és tovább is fogják képezni.

Az OpenAI súgóoldala szerint minden adat, beleértve a bizalmas ügyféladatokat, üzleti titkokat és érzékeny üzleti információkat, amelyeket Ön a chatbotnak ad meg, áttekinthető és felhasználható a rendszer fejlesztésére.

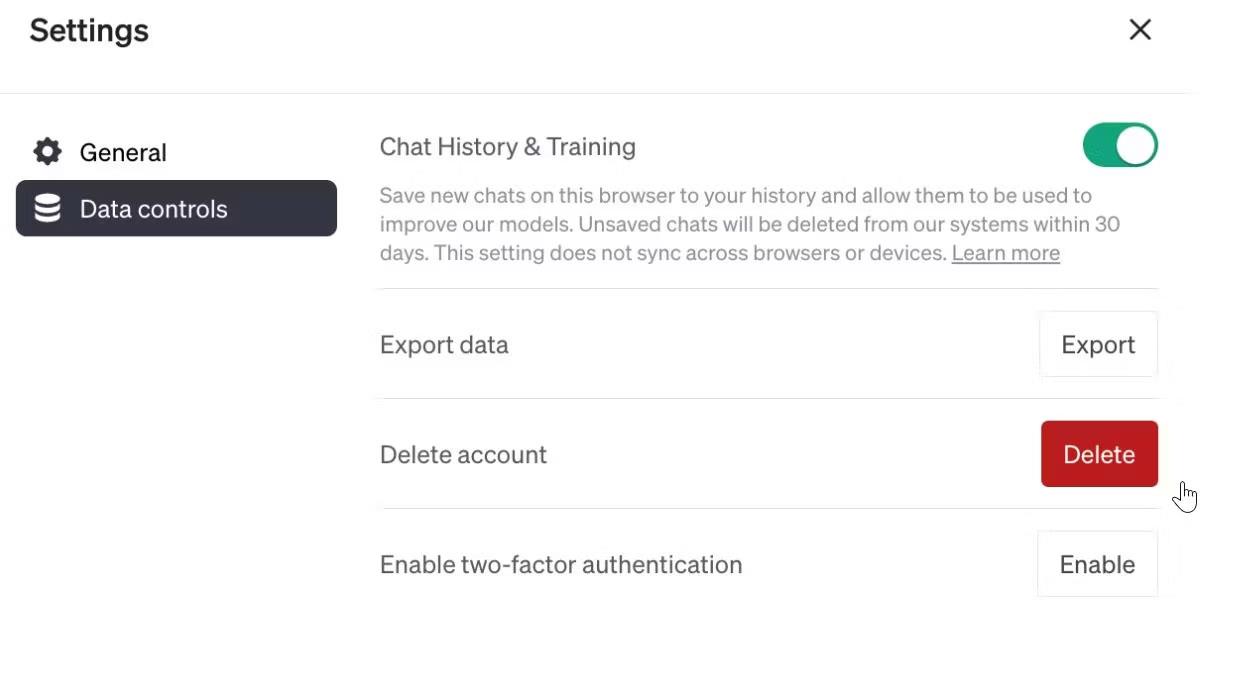

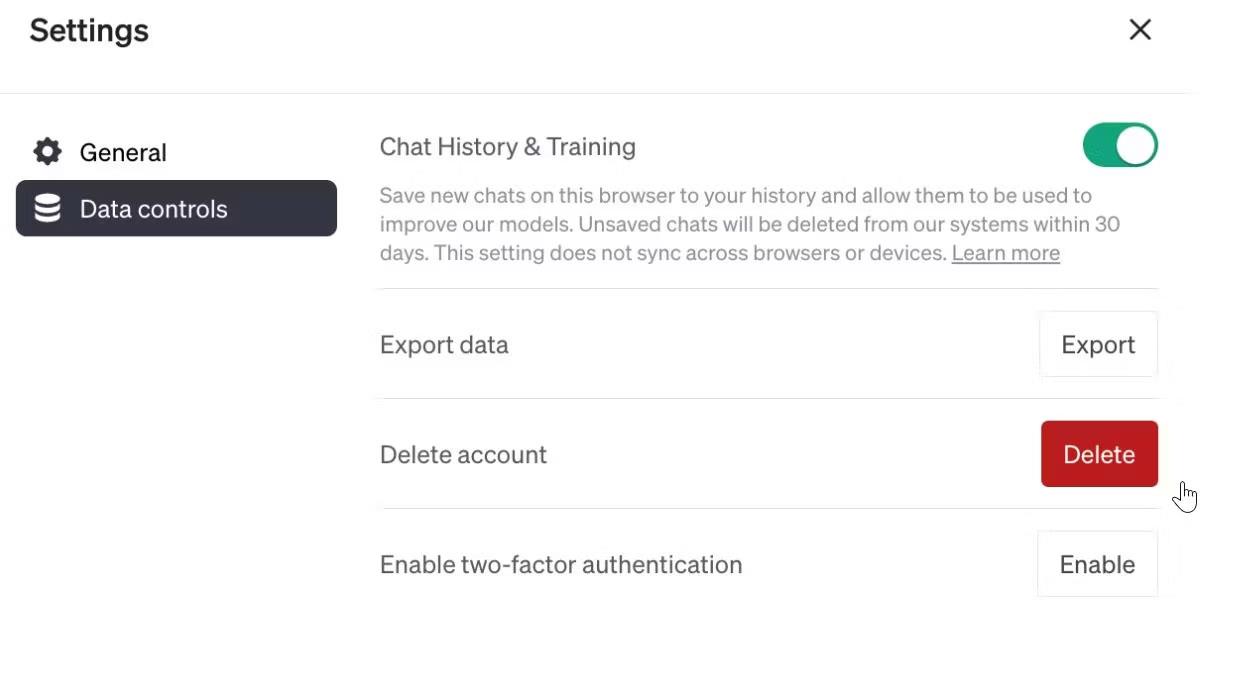

Többtényezős hitelesítés beállítása a ChatGPT-n

Sok vállalatra szigorú adatvédelmi előírások vonatkoznak. Ezért óvatosak a személyes adatok külső szervezetekkel való megosztásával kapcsolatban, mivel ez növeli az adatszivárgás kockázatát.

Emellett az OpenAI nem nyújt garanciát a tökéletes biztonságra és adatvédelemre. 2023 márciusában az OpenAI megerősített egy hibát, amely lehetővé tette egyes felhasználók számára, hogy megtekintsék a többi aktív felhasználó történetében szereplő csevegési címeket. Bár ezt a hibát kijavították, és az OpenAI hibaprogramot indított, a vállalat nem garantálja a felhasználói adatok biztonságát és titkosságát.

Sok szervezet úgy dönt, hogy korlátozza az alkalmazottakat a ChatGPT használatában, hogy elkerülje az adatszivárgást, amely ronthatja a hírnevet, pénzügyi veszteségekhez vezethet, és veszélybe sodorhatja ügyfeleit és alkalmazottait.

2. Kiberbiztonsági kockázatok

Bár nem világos, hogy a ChatGPT valóban érzékeny-e a kiberbiztonsági kockázatokra, lehetséges, hogy egy szervezeten belüli telepítése potenciális sérülékenységeket eredményezhet, amelyeket a kibertámadók kihasználhatnak.

Ha egy vállalat integrálja a ChatGPT-t, és a chatbot biztonsági rendszerében gyengeség mutatkozik, a támadók kihasználhatják a biztonsági rést, és megfertőzhetik azt rosszindulatú programokkal. Ezenkívül a ChatGPT azon képessége, hogy emberszerű válaszokat generál, „aranytojás” az adathalász támadók számára, akik fiókokat vehetnek át, vagy jogos entitásnak adhatják ki magukat, hogy rávegyék a vállalat alkalmazottait érzékeny információk megosztására.

3. Hozzon létre személyre szabott chatbotokat

Innovatív funkciói ellenére a ChatGPT hamis és félrevezető információkat hozhat létre. Ezért sok vállalat AI chatbotokat hozott létre munkavégzés céljából. Az ausztrál Commonwealth Bank például arra kérte munkatársait, hogy használják a Gen.ai-t, egy mesterséges intelligencia (AI) chatbotot , amely a CommBank információit használja a válaszadáshoz.

Az olyan cégek, mint a Samsung és az Amazon fejlett természetes nyelvi modelleket fejlesztettek ki, így a vállalkozások könnyen létrehozhatnak és telepíthetnek személyre szabott chatbotokat a meglévő átiratok alapján. Ezekkel a házon belüli chatbotokkal megelőzheti az adatok helytelen kezelésével kapcsolatos jogi és hírnévre vonatkozó következményeket.

4. Szabályozás hiánya

Azokban az iparágakban, ahol a vállalatokra protokollok és szankciók vonatkoznak, a ChatGPT szabályozási útmutatásainak hiánya piros zászló. A ChatGPT használatára vonatkozó pontos jogi feltételek hiányában a vállalatoknak komoly jogi következményekkel kell szembenézniük, ha mesterséges intelligencia chatbotokat használnak működésükhöz.

Ezenkívül a szabályozás hiánya csökkentheti a vállalati elszámoltathatóságot és az átláthatóságot. A legtöbb vállalat számára zavaró lehet, ha elmagyarázza ügyfeleinek az AI nyelvi modellel kapcsolatos döntéshozatali folyamatokat és biztonsági intézkedéseket.

A vállalatok korlátozzák a ChatGPT-t, mert aggódnak az adatvédelmi törvények és az iparág-specifikus szabályozások esetleges megsértése miatt.

5. Felelőtlen használat az alkalmazottak részéről

Sok vállalatnál egyes alkalmazottak kizárólag a ChatGPT-válaszokra támaszkodnak tartalom létrehozása és feladataik ellátása során. Ez lustaságot kelt a munkakörnyezetben, és elfojtja a kreativitást és az innovációt.

Az AI-ra támaszkodás akadályozhatja a kritikus gondolkodás képességét. A vállalat jó hírnevét is károsíthatja, mivel a ChatGPT gyakran pontatlan és megbízhatatlan adatokat szolgáltat.

Míg a ChatGPT egy hatékony eszköz, a tartományspecifikus szakértelmet igénylő összetett lekérdezések megoldására való használata ronthatja a vállalat működését és hatékonyságát. Előfordulhat, hogy egyes alkalmazottak nem emlékeznek a tények ellenőrzésére és az AI chatbotok által adott válaszok ellenőrzésére, mivel a ChatGPT által adott válaszokat mindenki számára egyforma megoldásnak tekintik.

Az ehhez hasonló problémák enyhítése érdekében a cégek betiltják a chatbotokat, hogy az alkalmazottak a feladataikra összpontosíthassanak, és hibamentes megoldásokat kínálhassanak a felhasználóknak.